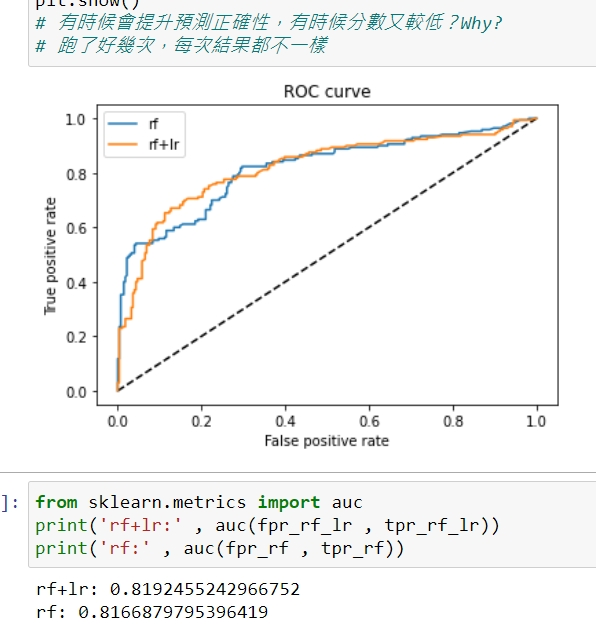

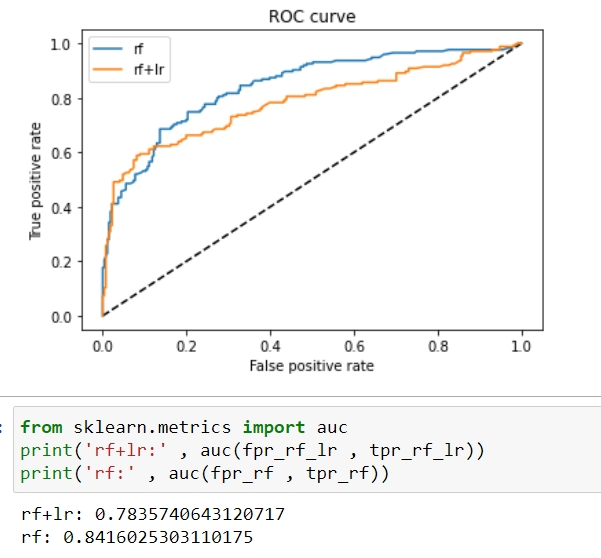

在作業中每次訓練得出的結果都不一樣,有時葉編碼分數更高,有時卻較低?

Hi 老師, 做完作業很不解的地方是每次結果都不一樣,時高時低,重複跑了好幾次 有時隨機森林+葉編碼+邏輯斯迴歸的分數高,有時隨機森林的分數高

回答列表

-

2021/10/19 下午 01:03王健安贊同數:0不贊同數:0留言數:0

Howard_Hsu您好, 模型每次結果不相同的原因會有很多種, 就模型角度來說, Random Forest使用Ensemble方法「Bagging」,每一次抽樣本子集合都不一樣, 因此每一棵樹的長相、最終結果都會不一樣, 而Logistic Regression除了每個特徵的係數外, 也會有額外的誤差項納入模型中, 每一次的誤差項數值都會不一樣; 此外當您把Random Forest與Logistic Regression合併操作Ensemble Learning時, 若沒有固定合併方法,也會有不一樣的結果, 綜上所述,其實在建立機器學習模型時有多個地方因為隨機性產生不同的最終結果, 因此若只有一種結果當成最終結果容易的偏誤, 建議可以重複多次並且取平均作為模型最終結果。 參考資料: 隨機森林(RANDOM FOREST)的底層概念、操作細節,與推薦相關資源http://notebookpage1005.blogspot.com/2018/03/random-forest.html 機器學習: Ensemble learning之Bagging、Boosting和AdaBoost https://chih-sheng-huang821.medium.com/%E6%A9%9F%E5%99%A8%E5%AD%B8%E7%BF%92-ensemble-learning%E4%B9%8Bbagging-boosting%E5%92%8Cadaboost-af031229ebc3 機器/統計學習: 羅吉斯回歸(Logistic regression) https://chih-sheng-huang821.medium.com/%E6%A9%9F%E5%99%A8-%E7%B5%B1%E8%A8%88%E5%AD%B8%E7%BF%92-%E7%BE%85%E5%90%89%E6%96%AF%E5%9B%9E%E6%AD%B8-logistic-regression-aff7a830fb5d