Tutorial 1(中間字預測)的 BertModel 作用?

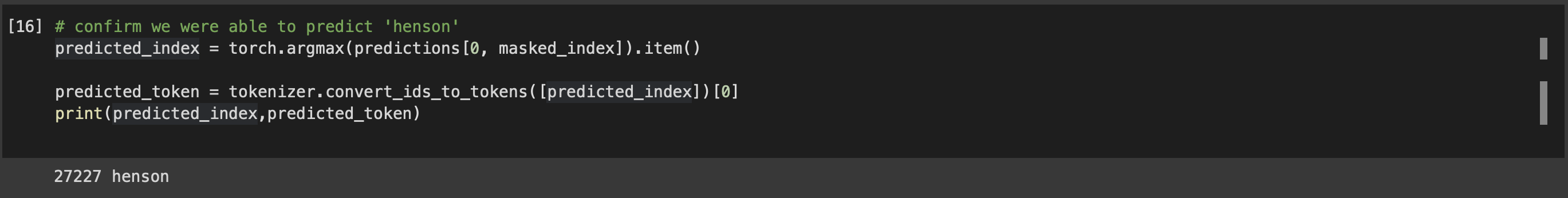

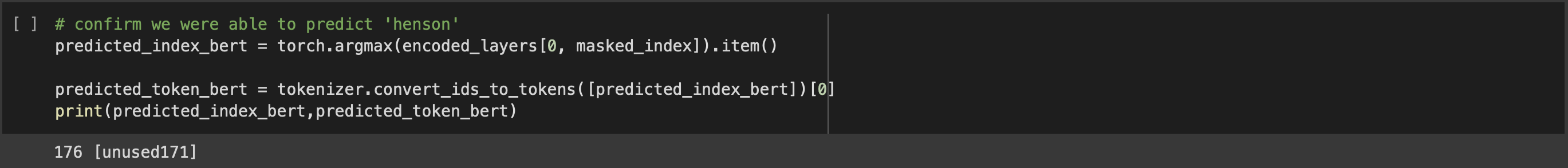

在程式碼中 load 了 BertModel 以及 BertForMaskedLM 兩個預訓練模型,但最後預測只使用 BertForMaskedLM 模型,如下圖:  想問那 BertModel 在這裡的作用是?若 BertModel 也可以做中間字預測那該如何知道它預測的答案?  因我在此將 BertForMaskedLM 的預測結果 predictions 換成 encoded_layers(BertModel 的 output[0]),結果有點詭異。

回答列表

-

2021/03/30 下午 02:14Paul贊同數:0不贊同數:0留言數:0

BertModel是Encoder, "Let’s see how we can use BertModel to **encode our inputs in hidden-states**:" Encoder之後可以串自己開發的Decoder/Classifier BertForMaskedLM是Predictor "And how to use BertForMaskedLM to **predict a masked token:**" 請參考:https://huggingface.co/transformers/quickstart.html

-

2021/03/30 下午 03:23張維元 (WeiYuan)贊同數:0不贊同數:0留言數:0

嗨,你好

以這個範例來說,BertModel 應該是沒有用到的。

嗨,你好,我是維元,持續在不同的平台發表對 #資料科學、 #網頁開發 或 #軟體職涯 相關的文章。如果對於內文有疑問都歡迎與我們進一步的交流,都可以追蹤 我的粉絲專頁 ヽ(●´∀`●)ノ